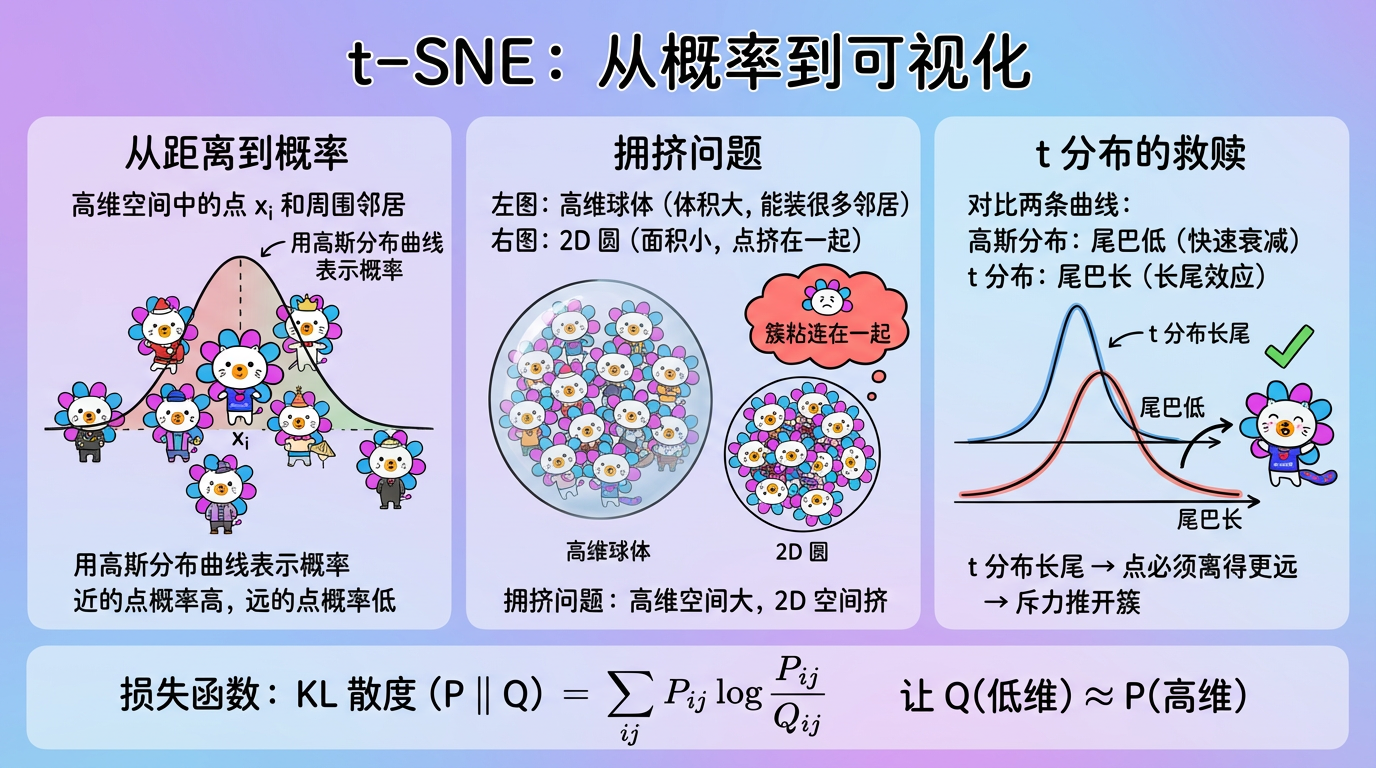

第 12 章:t-SNE深度解析

“在数据可视化的世界里,t-SNE 就是那个把乱麻理顺的魔术师。”

如果你在 Kaggle 上看过别人的 Kernel,你一定见过那种把 MNIST 手写数字完美分成 10 堆彩色小岛的图。

这种令人惊叹的“分堆”效果,90% 都是 t-SNE (t-分布随机邻域嵌入) 的功劳。

它不是在做数学投影(像 PCA 那些线性代数游戏),而是在做概率匹配。它强迫低维空间中的点,必须模仿高维空间中的社交关系。

本章我们将深入这个稍微有点复杂的算法内部,掰开揉碎了讲讲它是如何利用“学生 t 分布”来解决拥挤问题的。

(图注:上图是高维空间,下图是低维空间。t-SNE 通过梯度下降,不断移动下图中

第 11 章:非线性降维基础

“地球是圆的,但地图是平的。把球面画成平面的过程,就是流形学习。”

PCA 假设数据分布在一个平坦的超平面上。但现实世界的数据往往是卷曲的、扭曲的。

经典的例子是 “瑞士卷” (Swiss Roll) 数据集。数据像一块卷起来的地毯。

如果你直接用 PCA 从侧面压扁它(线性投影),原本相隔很远的两层会叠在一起,红色的点和蓝色的点就混淆了。这就叫投影混叠。

我们需要把这个卷小心翼翼地展开,就像把地毯铺平一样。这叫 流形学习 (Manifold Learning)。

1. 核心概念:流形假设 (Manifold Hypothesis)

流形学习基于一个大胆的假设:

虽然数据看起来维数

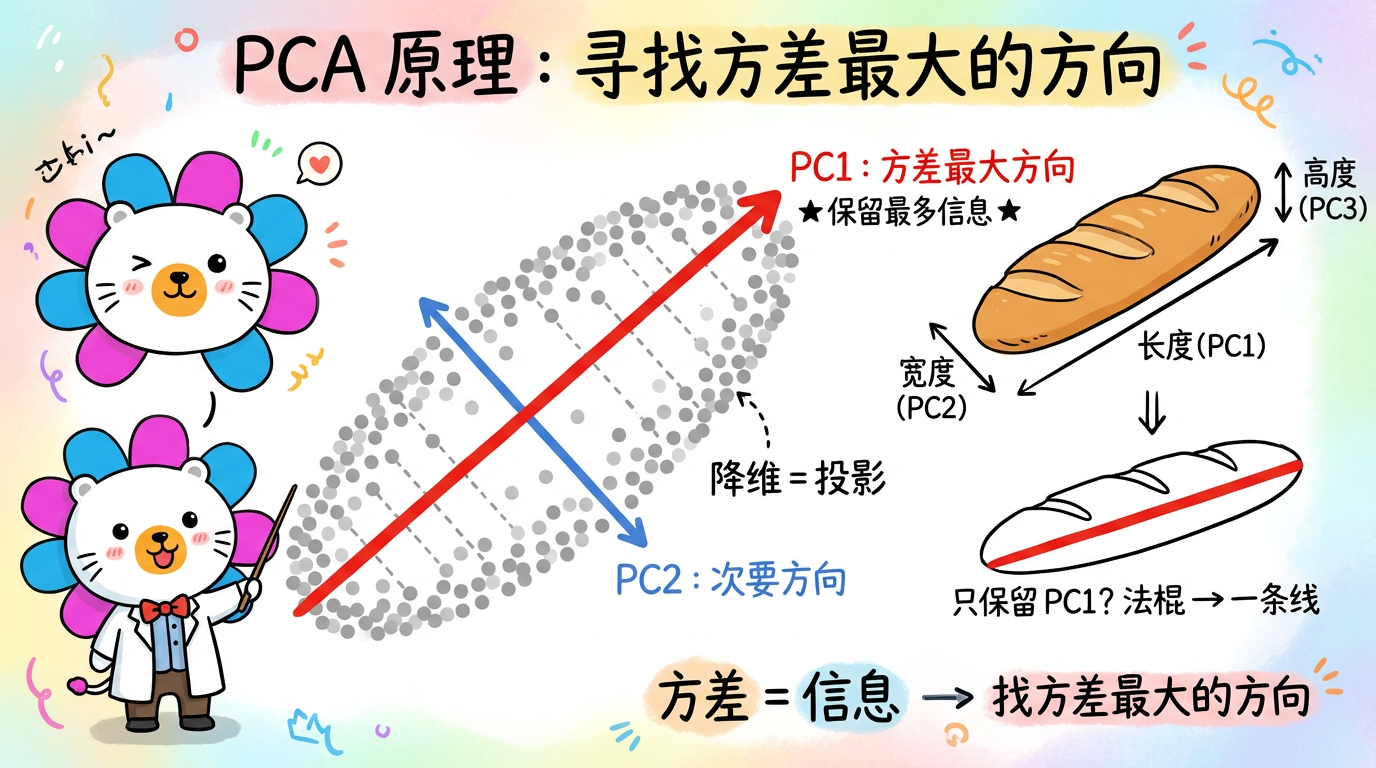

第 10 章:线性降维:PCA

“最好的数据压缩算法,不是 zip,而是理解数据的结构。”

我们生活在一个高维数据爆炸的时代。

* 图像:一张 100x100 像素的小头像,如果展平,就是 10,000 维的向量。

* 文本:一段包含 512 个 token 的文本,如果用 Embedding 表示,通常是 768 维或 1536 维。

* 用户画像:一个电商用户的特征,可能包含点击历史、购买力、地理位置等几千个指标。

在这些成千上万的维度中,往往充斥着冗余(比如“出生年份”和“年龄”完全相关)和噪声(比如图片边缘的随机噪点)。

降维 (Dimensionality Reduction) 的目标很简单:去粗取精。

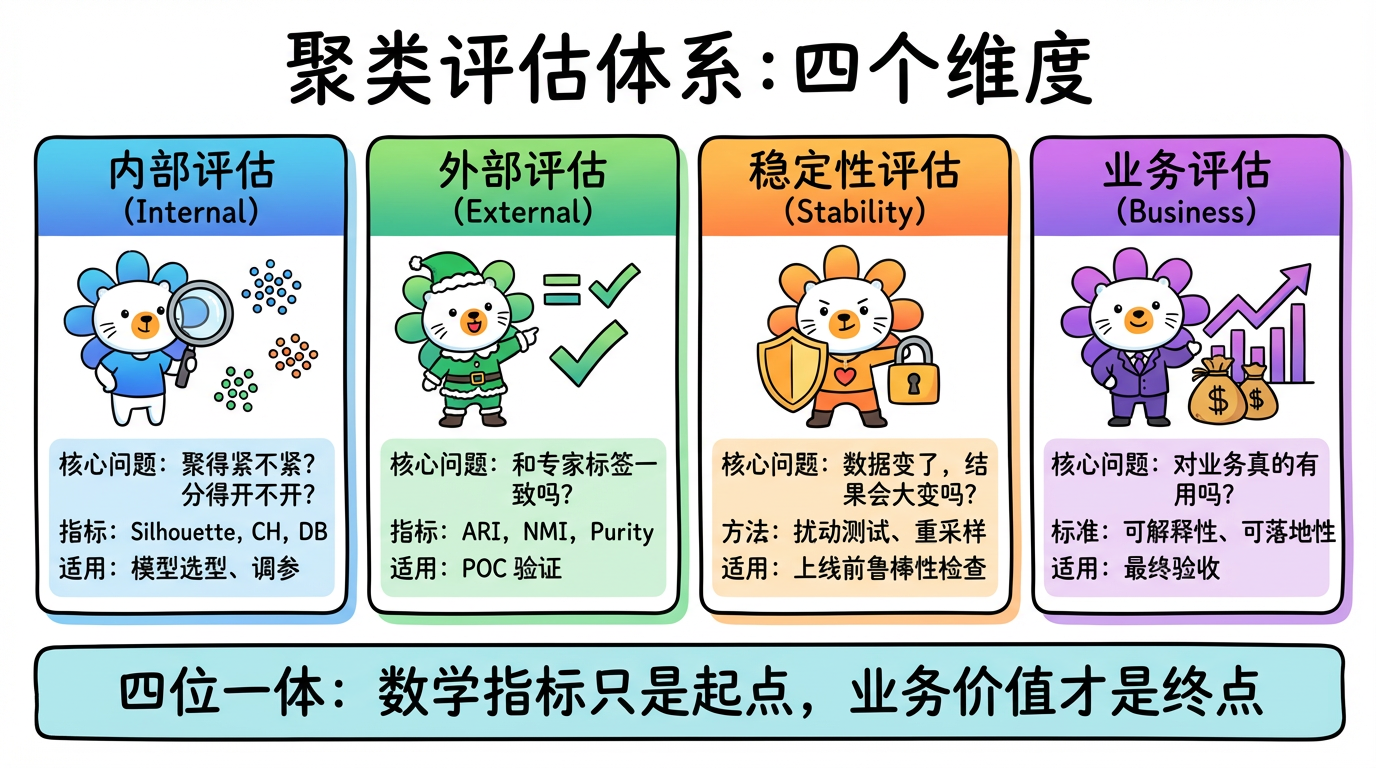

第 09 章:聚类评估方法

“没有标准答案的考试,该怎么评分?”

在监督学习(如猫狗分类)中,评估很简单:你猜对了多少个?Accuracy = 95%。

但在无监督学习中,我们没有 Ground Truth(真实标签)。

机器把数据分成了 3 堆,你怎么知道分得对不对?也许实际上应该是 4 堆?或者那两个点不该在一起?

本章我们将介绍一套系统化的评估体系。既然没有外部答案,我们就从内部结构、稳定性、业务价值等多个维度来审视聚类结果。

(图注:聚类评估的四个维度:内部评估、外部评估、稳定性评估、业务评估。)

1. 评估体系概览 (The Evaluation Taxonomy)

聚类评估不仅仅是算一个分数,

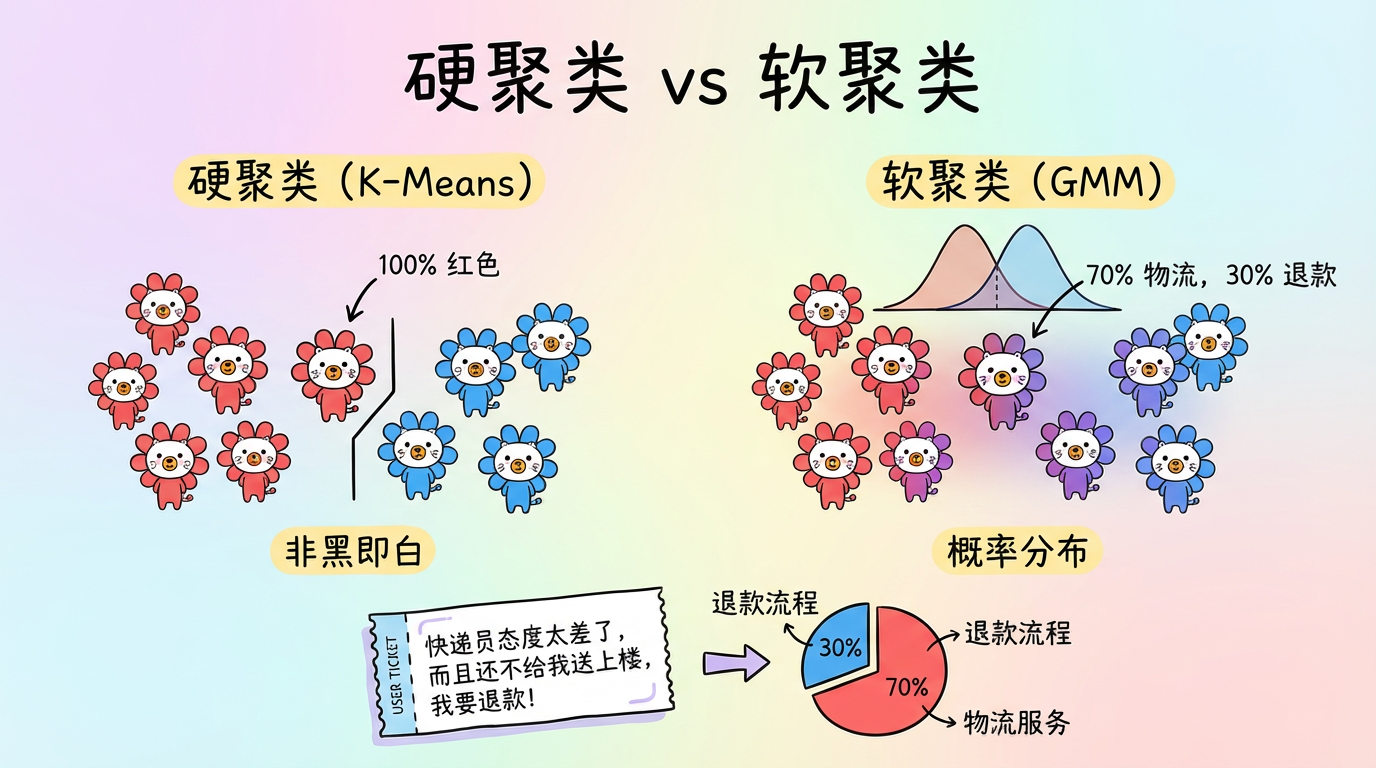

第 08 章:概率模型聚类

“上帝不掷骰子,但数据科学家掷。” —— 改编自爱因斯坦

之前的聚类算法(K-Means, DBSCAN)都有一个共同特征:硬聚类 (Hard Clustering)。

一个样本要么属于 A,要么属于 B,没有中间地带。

这就像把人简单分为“好人”和“坏人”,丢失了人性的复杂灰度。

在实际的文本分析场景中,我们经常遇到这种情况:

用户工单:”快递员态度太差了,而且还不给我送上楼,我要退款!”

这句话既涉及【物流服务】,又涉及【退款流程】。如果硬把它归为某一类,就会丢失另一半信息。

本章我们将介绍 高斯混合模型 (GMM, Gaussian Mixture Model),它引入了 软聚类