前几天在思考一个挺尖锐的问题,随着大模型和 Agent 技术的发展,程序员、工程师这些角色会不会被替代?在商业价值上还有没有站得住脚的稀缺性?

我是从前端工程师转型过来的,后来做了一段时间全栈,视野稍微宽了一些。回头看前端这个职能,再横向对比后端、算法这些岗位,越想越觉得这个问题不只是前端的问题——甚至可以说,后端工程师的许多工作内容比前端更容易被替代。

这个问题越想越深,最后变成了一场自我辩论。今天把这场思辨过程完整记录下来,欢迎拍砖。

辩题

在 AI 时代,技术执行角色将失去商业稀缺性;人在组织中的核心剩余价值将演变为政治性与责任性角色。

先把立场摆清楚:这不是在讨论”某个工种会不会写代码”,而是在追问商业稀缺性的结构性崩塌。我会先从前端工程师切入——因为这是我最熟悉的视角——再把论证延伸到后端、算法等所有技术执行职能。

第一轮|价值的本质

🔵 正方:稀缺性崩塌是信息论的必然

从最底层的逻辑出发:前端工程师的核心生产函数是什么?

本质上是一个翻译过程——将人类意图(设计稿、产品需求)翻译成机器可执行的界面逻辑。这个翻译过程,无论用 React 还是 Vue,无论写 CSS 还是调动画,其底层都是确定性的符号变换。

而大模型恰恰是人类有史以来最强大的符号变换引擎。当这个翻译过程可以被 AI 以接近零的边际成本复制时,稀缺性就在结构上被摧毁了。

这不是”AI 会不会写代码”的问题,而是信息论层面的必然性:一旦某种认知操作可以被充分数字化描述,它就可以被无限廉价复制。

商业价值的底层公式:当稀缺性趋近于零,价值随之崩塌

🔴 反方:这是还原论谬误

这个论证犯了一个经典的还原论谬误——把一个复杂系统的某个维度当成了全部。

我们从第一性原理重新审问:前端工程师究竟在做什么?

如果只是”翻译”,那 Dreamweaver 在 2005 年就应该淘汰前端工程师了,可事实相反,前端工程师的数量和薪资在此后二十年爆发式增长。为什么?

因为需求本身不是固定的输入。真实的工程现场,需求是模糊的、矛盾的、动态演化的。

一个前端工程师在处理的,远不止是”把设计稿变成代码”,而是:

- 这个交互逻辑在边界情况下会崩溃吗?

- 这个架构决策三个月后会产生多大的技术债?

- 这个设计在低端设备上体验如何?

- 产品经理要的和用户真正需要的是同一件事吗?

这些是判断问题(Judgment Problems),不是执行问题(Execution Problems)。AI 目前在执行层极其强大,但判断层需要的是对真实世界的因果理解,而非模式匹配。

第二轮|历史类比与结构性跃迁

🔵 正方:会计师的前车之鉴

反方的论证很有力,但它混淆了时间维度。

你说的”判断问题”是正确的,但你低估了 AI 能力的增长斜率是否会越过这个阈值。

更重要的是,我要引入一个历史上的结构性跃迁案例——会计师职业的演化。

20 世纪初,”会计师”是一个高度稀缺的职业,因为他们在做的事情在当时看来也是”判断问题”:如何分类账目、如何识别异常、如何解读财务逻辑。

电子表格出现后,人们说”判断还是需要人的”。

ERP 系统出现后,人们还是这么说。

但今天,基础会计的商业价值已经被压缩到近乎消失,留下的只是税务合规和审计签字——也就是政治性/责任性角色。

会计师职业的演化:从稀缺技能到责任签字

前端工程师正在经历同样的压缩路径。而且 AI 的压缩速度远比历次工具革命更快,因为它攻击的不是某一类具体操作,而是认知操作本身的通用基础设施。

🔴 反方:创造与执行的本体论差异

会计师类比是有启发性的,但有一个关键的结构差异:会计处理的是已经发生的事实,而前端工程处理的是尚未存在的可能性。

这是一个本体论层面的区别。

让我用第一性原理重新挖掘:“创造”和”执行”在认知结构上有什么本质不同?

执行,是在已知解空间中寻找正确路径;创造,是在定义解空间本身。

当一个前端工程师在思考”这个产品的交互范式应该是什么”时,他在做的是一件 AI 在当前架构下根本无法完成的事——他在为 AI 提供目标函数。

更根本的矛盾在此浮现:如果人的角色退化为纯粹的”政治性/责任性”角色,那谁来定义 AI 去做什么?

你的论点预设了一个隐形的”意图提供者”,但这个角色本身就是巨大的商业价值所在。今天叫”前端工程师”,明天可能叫”产品架构师”或”AI 意图设计师”——职位名称会变,但认知劳动的核心不会凭空消失,它只会上移。

第三轮|人的政治性角色——救赎还是异化?

🔵 正方:普通从业者的概率性崩塌

反方提出了”认知上移”这个概念,我接受它,但它恰恰强化了我的核心论点,而非反驳它。

“认知上移”意味着什么?意味着具体的技术执行能力不再是稀缺资源,被迫上移到更抽象的判断层。但这个上移过程对于大多数从业者来说是残酷的——就像工业革命后大量工匠”上移”到了流水线管理岗一样,能真正上移到决策层的,永远是少数人。

对于这个少数群体,我同意你的说法,他们有价值。

但我的命题的真正意指是:在概率分布上,大量从事前端工程的普通从业者将面临商业价值的系统性崩塌。

而公司雇用他们,不是因为他们的技术能力不可替代,而是因为——正如我最初说的——他们需要一个法律主体和道德主体来承担错误、签字、出席会议、面对监管。这是一种本质意义上的功能性降格。

🔴 反方:这是替罪羊,不是价值

这里我要指出你整个论证体系中最深层的一个悖论。

你说:未来人在组织中的价值是”承担责任”和”面对外部压力”。

但第一性原理告诉我们,如果责任是有意义的,它必须锚定于某种真实的能力和判断;如果一个人对某个决策毫无理解、毫无参与,只是在名义上”承担责任”——那这不叫”价值”,这叫替罪羊。

这里有两种可能的未来:

第一种(你的版本): 技术判断全部由 AI 完成,人只是签字画押的法律外壳,这是人的彻底工具化——也是一种你自己都未必愿意接受的异化状态。

第二种: 恰恰因为 AI 承担了大量执行工作,人从繁琐的实现细节中被解放出来,得以将更多认知资源投入到真正需要人类判断的问题上:价值权衡、伦理决策、意义构建、关系协调。这是一种认知的升华,而不是降格。

终局之问:这是异化还是解放?

最根本的哲学问题在此:你对”价值”的定义,预设了一个稀缺性驱动的市场框架。

但在一个生产力极度充裕的 AI 时代,”价值”的定义本身是否会发生根本性的重构?当代码不再稀缺,”理解为什么需要这段代码”反而会成为新的稀缺性——而这种理解,历史上一直叫做智慧,而不叫”前端工程”。

扩展到所有工程角色

辩论到这里,我把范围再扩大一点:后端、算法工程师呢?

🔵 正方的进一步论证

把范围扩展到后端、算法工程师之后,论证其实更有力了,不是更弱了。

我们来拆解几个典型角色的核心生产函数:

后端工程师的本质是:设计数据流动的管道,保证系统在规模和故障下的稳定性。这是高度形式化的问题——CAP 定理、事务边界、API 契约——这些都是可以被精确描述的约束空间,而精确描述的问题,正是 AI 最擅长的领域。

算法工程师的本质是:在数据上找到统计规律,并将其工程化。但讽刺的是,AI 本身就是这个过程的产物,用 AI 来替代训练 AI 的人,在逻辑上是完全自洽的。

三类角色,本质上都在做同一件事:在已知约束条件下,寻找最优的符号变换路径。这正是大模型+Agent 的核心能力范围。

前端、后端、算法工程师:都在做符号变换,AI+Agent 正在覆盖三者

所以,从第一性原理出发,”干掉执行层”在终态上是结构性必然,而不是悲观预测。

🔴 反方的核心挑战

但这里有一个被掩盖的核心假设,必须挖出来:

你默认”懂业务的人”和”做执行的人”是可以被清晰分离的两类人。

这个假设在现实中是错的,而且错得很深。

让我用第一性原理重新问:业务判断的认知基础是什么?

一个产品经理说”我们需要一个推荐系统”,这是业务判断。但当 AI 问他:”请问你要优化点击率还是停留时长?冷启动怎么处理?实时性要求是什么量级?”——如果他回答不了这些问题,他给出的”业务判断”就是一个空洞的意图,AI 无法从中产生有效的执行。

也就是说,有效的业务判断,必须内嵌对执行层的深度理解,否则它只是一句话的愿望,而不是可操作的决策。

业务判断不是空洞意图,必须内嵌执行层深度理解才能有效

你想”干掉”的那些执行层知识,恰恰是让业务判断变得有效的认知基础设施。干掉执行层的人,很可能同时摧毁了业务层的判断质量。

🔵 正方的回击:AI 是天然翻译器

这个反驳听起来很有力,但它建立在一个即将过时的前提上:业务判断者需要懂技术细节,是因为过去没有能弥合这个鸿沟的中间层。

但 AI Agent 恰恰就是那个自然语言到技术实现之间的实时翻译器。

当一个产品经理说”我要推荐系统”,未来的 AI 会自动追问所有必要的技术约束,自动枚举权衡方案,自动生成可演示的原型——整个”需要懂技术才能做好业务判断”的认知前提,会被 AI 的接口能力所溶解。

AI Agent 溶解了”需要懂技术才能做好业务判断”的认知前提

这意味着:不是”执行层和业务层合并了”,而是执行层被 AI 内化了,业务层的人不再需要把技术深度作为入场券。

所以”干掉执行层的人”这个说法虽然粗暴,但指向的结构是真实的:独立存在的、以技术执行为唯一价值的岗位,会失去其存在的商业合理性。

🔴 反方的终极追问

好,我接受这个论证的结构方向。但现在让我把问题推到底:

如果执行层被 AI 内化,那”业务判断”这件事本身,凭什么不被 AI 内化?

你不能在逻辑上既承认 AI 可以内化执行层的全部认知,又同时主张业务判断层有某种神秘的人类豁免性。这是一个特例豁免谬误。

从第一性原理看:业务判断 = 目标函数的设定 + 约束条件的识别 + 利益相关方的协调。前两项在数据充分的情况下,AI 的能力边界正在逼近。第三项——利益协调——才是你所说的”政治性角色”的真正内核。

而利益协调的本质是什么?是在多个主体之间,处理那些没有唯一正确答案的价值冲突。这不是一个认知问题,而是一个权力与信任的问题——谁说了算,谁来背锅,谁被信任。

利益协调不是认知问题,是权力与信任:谁说了算?谁来背锅?谁被信任?

所以你的原始论点其实抓住了一个非常深刻的东西:未来组织雇用人类,核心原因之一是人类是唯一能在法律和道德上承担责任的主体。AI 不能被起诉,不能被开除,不能在股东大会上被问责。

但这也意味着,这种”政治性价值”本质上是一种制度性摩擦的产物——它存在,不是因为人类认知更优秀,而是因为我们的社会制度还没有准备好让 AI 承担主体责任。

真正的哲学断层线

整个辩论走到最后,暴露出的不是一个关于工程师的问题,而是两个更深的命题:

第一: 当 AI 的认知能力全面超越人类执行层之后,人在生产组织中的位置,究竟是因为真实的认知价值,还是因为制度性的责任锚点?如果是后者,那人的”工作”本质上变成了一种社会契约的配角,而非生产力的主角。

第二: 你说的”干掉执行层”——这个”干掉”是市场行为,还是文明选择?历史上每一次生产力革命,都有大量岗位消失,但同时涌现出新的岗位形态。真正的问题不是”前端工程师会不会消失”,而是——

在一个执行成本趋近于零的世界里,人类的劳动还需要用来换取生存资源吗?还是说,我们面对的根本不是一个”谁的工作消失了”的问题,而是一个”工作本身作为分配机制是否还成立”的文明级问题?

终局之问:当执行成本趋近于零,工作作为分配机制还成立吗?

小结

| 层面 | 正方主张 | 反方挑战 |

|---|---|---|

| 价值论 | 稀缺性崩塌→商业价值消失 | 认知劳动上移,价值重构而非消失 |

| 历史类比 | 会计师路径,执行层系统压缩 | 创造与执行的本体论差异 |

| 人的角色 | 政治性/责任性角色是终局 | 这是异化,还是解放?取决于定义 |

| 核心悖论 | 普通从业者的概率性崩塌 | 若责任脱离能力,则”价值”只是替罪羊 |

最后的开放命题

这场辩论没有标准答案,但它指向了一个每个人都应该思考的问题:

你所说的”价值”——究竟是市场交换价值(稀缺性×需求),还是存在性价值(人在生产关系中的真实参与)?

如果是前者,正方的论点非常有力。

如果是后者,AI 时代可能不是工程师价值的终点,而是一场关于人应当做什么的更深层的文明追问。

延伸一|”前端能带来商业价值”——这类话是自嗨吗?

辩论走到这里,有个更扎心的问题冒出来了:

既然执行层正在被系统性替代,那那些在公司里讨论”前端能带来商业增量价值”的言论,岂不都是自嗨?

在很大程度上,是的。

但”错在哪里”需要说清楚——这不是简单的”都是废话”,而是一个层次搞错了的问题。

论证对象偷换了

“前端能带来商业增量价值”这类话,犯的不是事实错误,而是把两个命题混成了一个。

它证明的是:优质的界面交互工作,能带来商业价值。 ✓

但它没证明的,也是真正要证明的是:这件事必须由一个专职的人类前端工程师来完成。 ✗

这两件事在过去二十年是绑在一起的,所以大家没意识到它们其实是两回事。AI 把这个绑定关系切断之后,整个论证就悬空了。

打个比方:你可以严格论证”精准的电梯停层操作对乘客体验至关重要”——这完全是真的,但推不出”电梯操作员这个岗位有不可替代的价值”。论证的靶子打偏了。

前端工作有价值 ≠ 前端工程师不可替代,论证的靶子打偏了

这类话的真实功能是什么

从社会学角度看,”前端带来商业价值”这套论述,背后真正在做的事往往是这三件:

- 组织内部的政治自保——裁员压力下,证明自己团队不该被砍

- 社区身份认同的维系——前端社区需要一套集体叙事来维持凝聚力

- 认知延迟的缓冲——人面对结构性威胁时,本能先在现有框架里找安全感,而不是直面框架本身的崩塌

都是真实的人类需求,但不是在做严肃的商业分析

但有一个重要的区分

这类言论不是”毫无用处”,而是用错了地方。

如果一个工程师,基于对 AI 能力边界的清醒认识,去讨论”在 AI 还搞不定的哪些特定场景里,人类判断仍有短期优势”——这类论证是站得住脚的,因为它承认了大方向,只在争论时间窗口和边界条件。

但如果是在回避”执行层系统性贬值”这个前提,然后在这个回避之上建论证——那就是自嗨,因为地基是一个不愿被检视的假设。

所以,真正值得讨论的不是”前端有没有商业价值”,而是:

当一个人意识到自己的岗位正在被结构性替代时,他真正需要回答的问题是什么?

有两种回答方式。一种是在原有身份框架里论证自己的价值——这就是自嗨。另一种是跳出身份框架,去问:我实际上在解决什么问题,这个问题在 AI 时代还存在吗,如果存在,我需要以什么新的形态去处理它?

第二种追问才是有效的,但它要求你先放弃对原有职业身份的防御性执着——而这恰恰是大多数人最难做到的事,因为职业身份不只是饭碗,它还是自我认同的一部分。

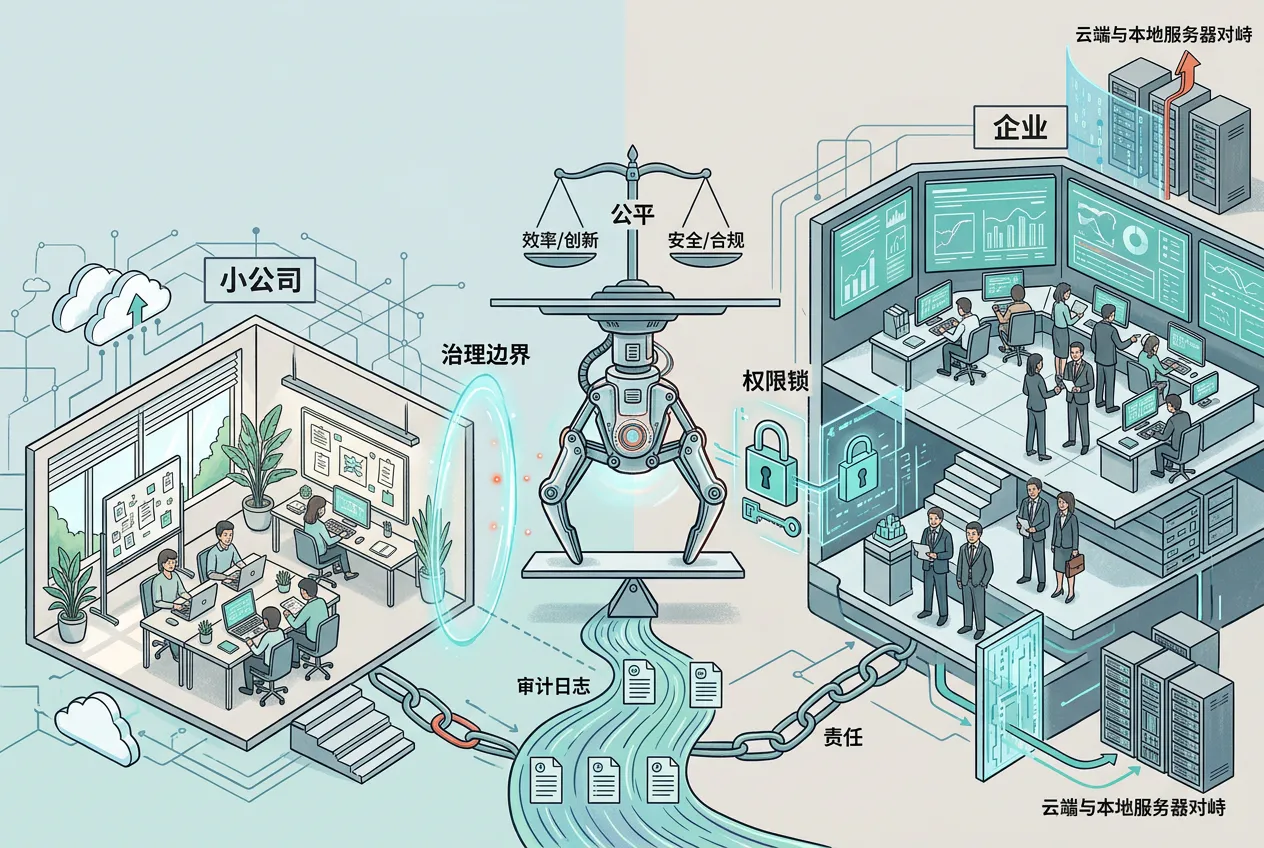

延伸二|企业视角:职能和人才激励该怎么重新分配?

把视角从个人切换到企业:执行层正在被 AI 系统性替代,公司的职能结构和人才激励该怎么调?

先想清楚稀缺的是什么

讨论”给谁高薪”之前,得先回答一个更基本的问题:AI 时代,企业真正稀缺的生产要素是什么?

过去二十年,稀缺的是会写代码的人,技术实现本身就是瓶颈。往后这个稀缺要素会根本性地转移——变成能精确定义问题的人、能承担结果责任的人、能在真正的不确定性里做判断的人。

激励体系必须跟着稀缺要素走,而不是跟着历史惯性走。

三类需要重新定位的角色

传统互联网公司的人才结构是个正三角形:底层大量执行层,中层管理,顶层决策。AI 会把这个结构压扁,变成更薄但单人杠杆极高的组织形态。

AI 把人才结构压扁了,变成更薄但单人杠杆极高的组织

第一类:问题定义者。 未来最稀缺的角色,但现在几乎没有公司把它显式建制出来。这类人的核心能力不是技术深度,也不是管理能力,而是能在模糊的商业现实里,把”我们想要什么”转化成”我们需要解决哪个精确的问题”。他们既懂业务逻辑,又能跟 AI 系统形成有效对话,还能判断 AI 的输出有没有对准真实目标。这类人极为罕见,因为过去的职业培养路径根本没有系统性地生产他们。

第二类:结果负责人。 就是那种懂业务、懂需求、在公司内承担政治责任的人。但要注意,这不是传统意义上的”产品经理”或”业务负责人”,而是对结果有真实所有权感的人——不是在传递指令,而是在真正押注自己的判断。这种人和那种”流程上是负责人但实际上在规避风险”的人,表面职级相同,价值天壤之别。激励体系得能区分这两种人。

第三类:AI 系统的编排者。 从传统执行层里会分化出来的一小部分人,价值不在于自己能写多好的代码,而在于能把一个复杂的业务问题拆解成 AI 可以并行处理的任务流,并知道哪些节点需要人工介入判断。本质上是新型的系统架构师,只不过架构的对象从代码系统变成了人机协作流程。

从代码架构师 → 人机协作架构师

激励重新分配的原则

薪酬向判断质量倾斜,而不是执行深度。 过去给写了十年复杂系统的工程师高薪,因为他的知识积累难以替代。这个逻辑往后会加速失效。真正值得高薪的,是那些能在数据不充分、目标不清晰的情况下做出高质量判断,并且事后被验证是对的人。

期权和长期激励向承担真实不确定性的人集中。 AI 做确定性的工作,人做不确定性的赌注。一个人的工作是在既定规范下执行,他的价值趋向于被 AI 定价;一个人的工作是在没有既定规范的情况下做选择,他的价值就是人类判断力本身。

执行类岗位不是立刻清零,而是给一条明确的转型通道。 这既是务实的,也是在组织内部维持信任的前提。可以直接告诉前端、后端工程师:纯执行工作的比重会下降,但如果能往问题定义或 AI 编排方向发展,公司会给资源和时间窗口。给出这个通道,同时让激励体系真实地指向转型后的方向,而不是维持现状。

薪酬向判断质量倾斜,期权向不确定性承担者集中

最容易踩的坑

最大的陷阱是把”懂 AI 工具”误认为新的核心竞争力,然后搞一套”谁用 AI 用得溜谁就值钱”的评价体系——这是把工具熟练度和判断力混为一谈了。会用 Cursor 不等于能定义对的问题,会调 Prompt 不等于懂业务本质。

如果激励体系最终变成了一个”筛选 AI 重度用户”的机制,只是把技术执行换了个外壳,底层逻辑一点没变。

一句话结论

高薪激励那些在没有答案的情况下能押出正确答案的人,而不是那些在有答案的情况下能最快实现答案的人。

后者的市场正在被 AI 定价,前者的市场正在被 AI 拉高。

你现在的人才体系里,这两种人可能挂着同样的职级,拿着差不多的薪水——这才是最需要重新梳理的地方。