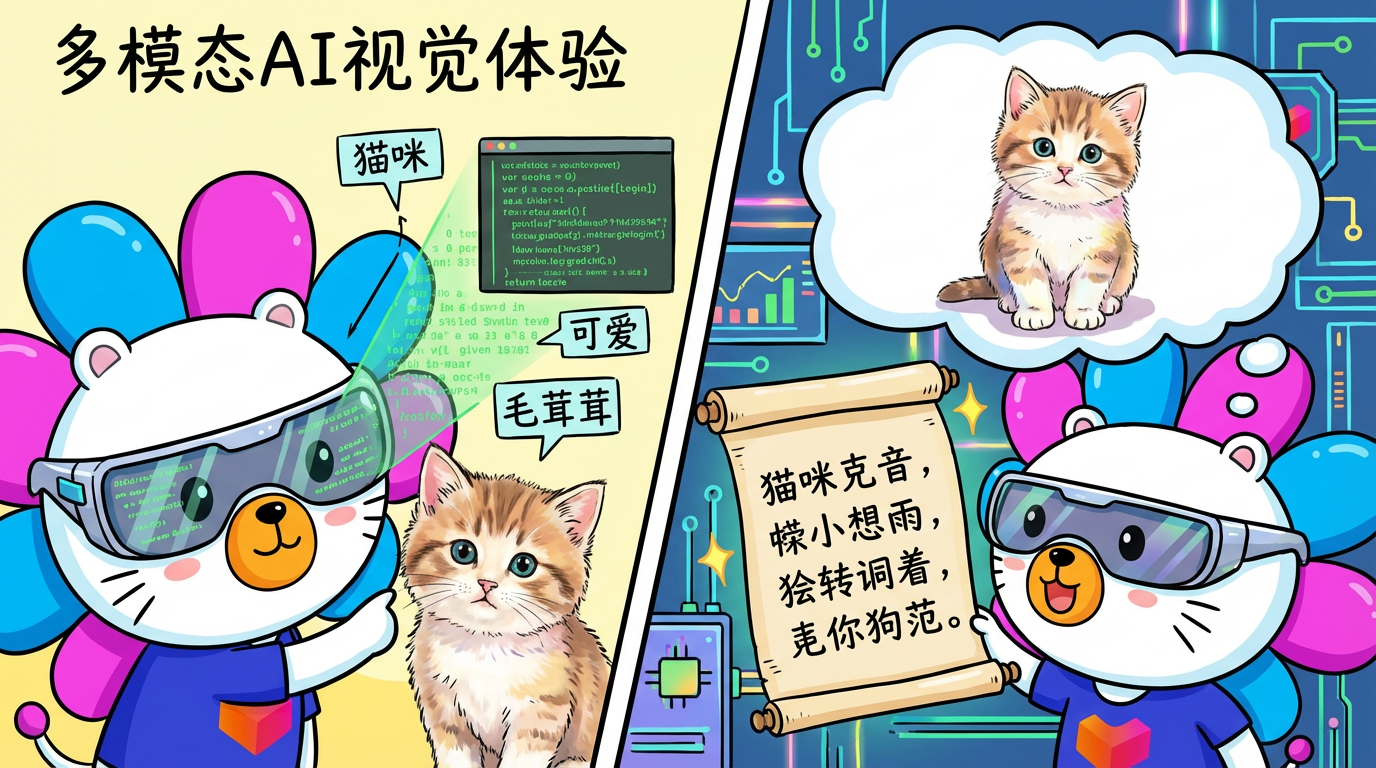

第 03 章:RAG 基石:Embedding 与向量检索

核心观点:在 AI 的眼里,万物皆是坐标。RAG(检索增强生成)的本质,就是把用户的自然语言问题,映射到知识库的坐标系中,寻找最近的”邻居”。

1. 引言:计算机不懂中文,它只懂数学

你问 AI:”苹果怎么卖?”

在计算机底层,它根本不知道”苹果”是水果还是手机。

但如果你告诉它:”苹果”的坐标是 [0.8, 0.2],”香蕉”的坐标是 [0.85, 0.1],”卡车”的坐标是 [-0.5, 0.9]。

它会立刻计算出:苹果和香蕉很近,离卡车很远。

这就是 Embedding(向量化) —— 它是 RAG 系统地基中的地基。

2. 核心概念:Embedding Space (向量空间)

2

第 02 章:算力与推理工程:显存与量化

核心观点:在大模型推理中,搬运数据的时间远多于计算的时间。推理优化的核心战役,就是打破”内存墙”(Memory Wall)。

1. 引言:你的显卡为什么在”摸鱼”?

你买了昂贵的 RTX 4090,跑大模型时却发现 GPU 利用率只有 30%?

不要怪显卡,它很委屈。

它就像一个米其林三星大厨(Tensor Core 计算核心),切菜速度极快,但他必须等服务员从几公里外的仓库(显存 VRAM)把土豆一个一个搬过来。

大模型推理的瓶颈,通常不在算力(Compute Bound),而在显存带宽(Memory Bound)。

2. 核心概念:内存墙与 KV Cache

2.1 显存:寸土寸金的仓

第 01 章:大模型解剖学:参数与 Scaling Law

核心观点:大模型本质上是对人类知识的”有损压缩”。参数量决定了压缩的”分辨率”,而 Scaling Law 揭示了算力转化为智能的物理定律。

1. 引言:智能的”分辨率”

当我们谈论 7B、70B、671B 这些数字时,我们在谈论什么?

很多人认为参数量仅仅意味着”更大的硬盘”,存了更多的死记硬背的知识。大错特错。

参数量实际上代表了模型对世界认知的分辨率。就像一张 JPG 图片,像素越高,边缘越清晰;参数越多,模型对逻辑、因果、微妙情感的”边缘”刻画就越精准。

本章我们将拆解这个黑盒,看看智能是如何从这些浮点数中涌现的。

2. 核心概念:压缩即智能

2.1 这里的”压缩”不是 WinRA

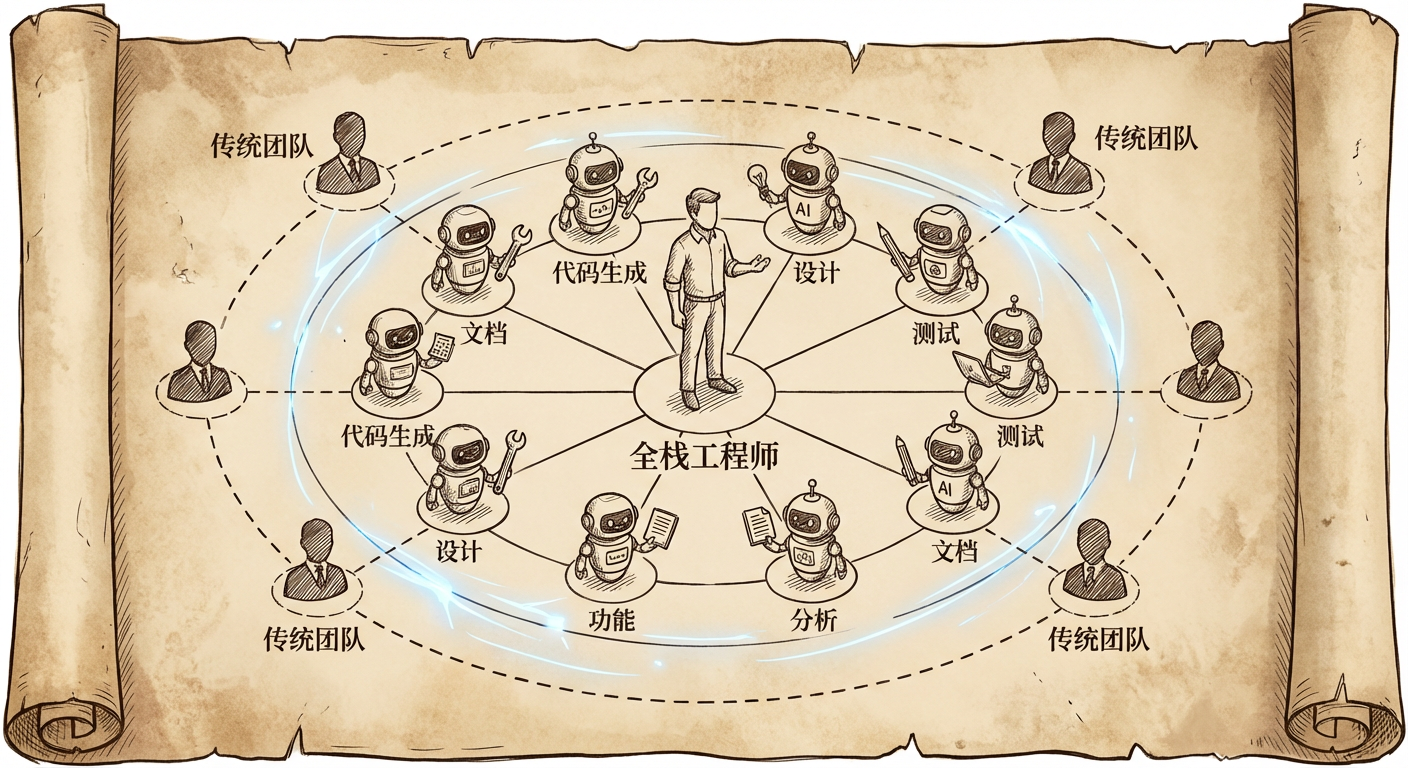

10X AI 全栈工程师的进化之路

内网文档 - 全栈手册)

👆🏻 全栈手册,是我在近期全栈化转型过程汇总梳理的较为结构化、系统性的知识库手册,希望能够对后来人有所帮助。

自我介绍:

1. 还是前端的我,目前负责 Lazada B 端前端基建,Merlion UI (UI 框架)) 作者,LAGO (页面发布平台))、Lazada Material (物料平台)) 等平台主要设计者及维护人,维护 Lazada 商家工作台 Node.js 应用(1000+ QPS)。

2. 开始转 Java 全栈的我,不到 4 个月被紧急成长完成了 Java 迭代需求 30+,主导大型重点项目 —— 智能审核(40 人日以上)交付

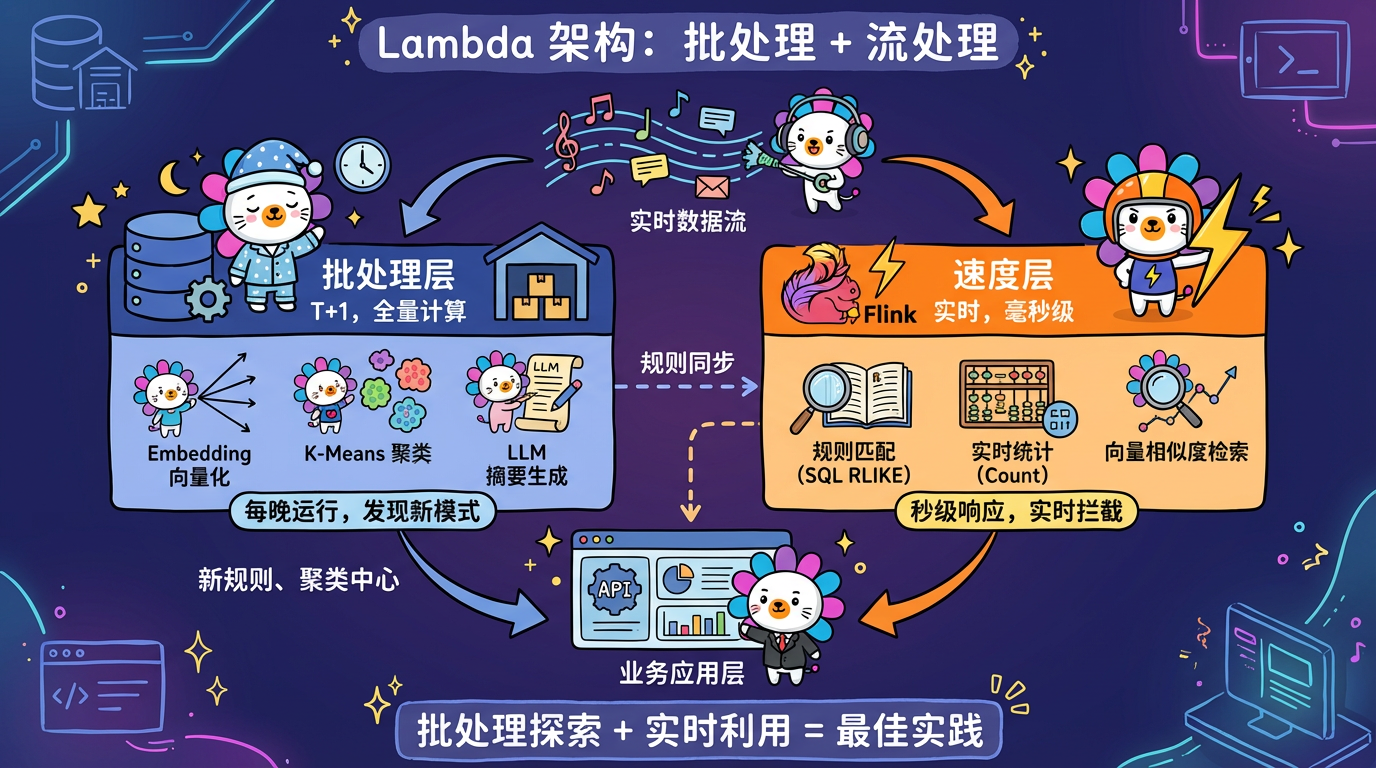

第 20 章:系统架构与工程实践

“算法只是冰山一角,工程才是水面下的巨兽。”

恭喜你,你已经掌握了无监督学习的所有核心算法。

但在实际工作中,写出算法代码可能只占 10% 的时间。

剩下的 90% 时间,你在处理:数据管道、异常恢复、性能优化、成本控制。

本章将以一个典型的文本分析系统为例,剖析工业级数据挖掘系统的架构设计。

1. 核心概念:批处理 vs 流处理

1.1 批处理 (Batch Processing)

* 模式:T+1。每天凌晨把昨天的数据全量跑一遍。

* 适用:Embedding, KMeans, LLM 总结。这些算法很重,没法实时跑。

* 常见选择:文本分析系统通常采用批处理。因为”风险挖